歐盟《人工智慧法案》之風險基礎模式

2023.05.26

瀏覽數

2686

壹、新聞重點

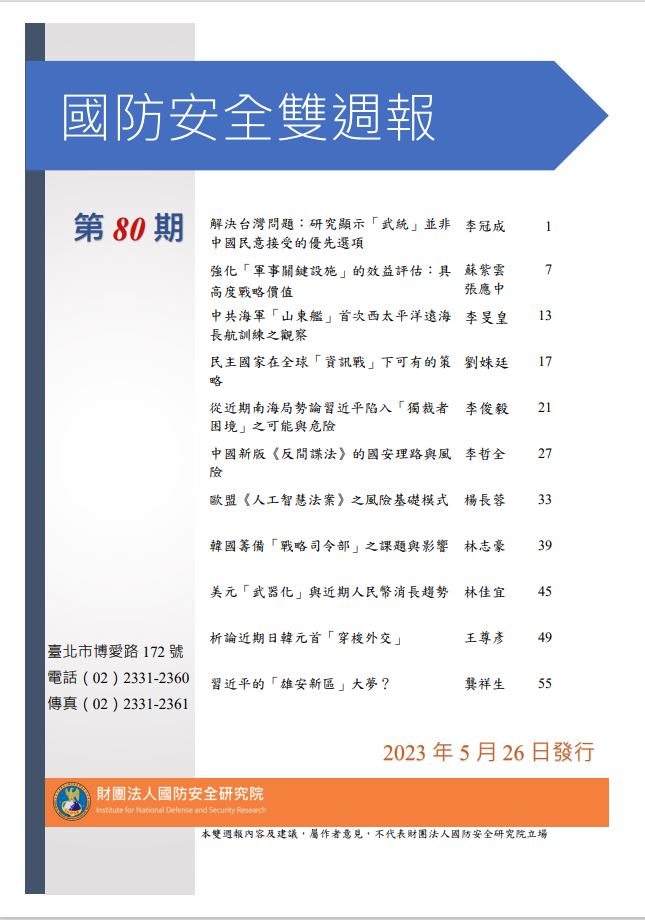

在今(2023)年5月11日,歐洲議會(European Parliament)初步通過《人工智慧法律調和規則草案》(Proposal for a Regulation Laying Down Harmonised Rules on Artificial Intelligence, (Artificial Intelligence Act) and Amending Certain Union Legislative Acts,下稱《歐盟人工智慧法草案》)。[1] 與原本2021年版有諸多不同之處。歐洲議會將於今年6月對《歐盟人工智慧法草案》進行全體投票(plenary vote),若通過將是世界上第一部專門針對人工智慧(Artificial Intelligence, AI)系統的法律。[2]

該法目的主要在確保AI系統仍是「以人為本」(human-centric)且具道德性發展,應由人類監督,並符合安全、透明度以及非歧視性等要求。其立法核心採取「風險基礎論」(risk based approach)來監管AI系統,[3] 並依照AI系統可能對人的基本權利產生威脅之等級分類。該法目前版本禁止「生物識別監控」(biometric surveillance)、「情緒識別」(emotion recognition)、「預測性警務」(predictive policing )等AI系統。

貳、安全意涵

一、AI快速發展影響監管力道

為了因應AI系統帶來的種種挑戰,歐盟執委會(European Commission, EC)在2021年4月21日即提出了管理AI的相關法案,《人工智慧法律調和規則草案》。[4] 然而近期AI發展快速,原訂內容無法跟上技術發展。特別是「生成式能力」(generative capabilities)AI,例如ChatGPT之出現,雖然帶來創新與極大利益,卻也帶來各種政策難題,特別是涉及隱私權與智慧財產權、問責性與責任,以及對其可能散播假訊息與錯誤資訊的潛在可能。

雖然目前對AI並沒有統一定義,科學界大多認為可區分為兩種:「狹隘人工智慧」(Artificial Narrow Intelligence, ANI),或「弱AI」(weak AI),主要是在有良好的「資料標記之資料集」(well-labelled dataset),並在預定的環境中運作以執行特定任務,例如圖片辨識系統。而「通用人工智慧」(artificial general intelligence, AGI)技術,又被稱為「強AI」(strong AI),能從經驗中學習,且被設計為可以進一步發現與預測能力。[5]

而在近期的AGI中,出現了新一波有「生成式能力」的AI,亦被稱為「通用目的人工智慧」(general purpose AI)或是「基礎模型」(foundation models),則是在更廣泛且無標誌資料集下進行訓練,且可執行各種任務,僅需進行微調( minimal fine-tuning)。[6] 這些模型目前被許多公司使用,為終端用戶提供服務。

二、歐盟AI草案採依風險等級分類模式

《歐盟人工智慧法草案》採取「風險基礎論」(risk based approach)來監管AI系統, 並依照AI系統可能對人的基本權利產生威脅之等級分類為4級,從「不可接受的風險」(unacceptable risk)、「高風險」(high risk)、「有限的風險」(limited risk)到「最小風險」(minimal or no risk)四個等級,[7] 說明如下。

(一)「不可接受的風險系統」

若使用AI系統被認為對於人的安全、生命與基本權利有明顯的威脅,將被禁止使用。例如政府進行的「社會評分制度」(social scoring/credit system)、鼓勵危險行為具有語音助理功能的玩具系統等。

(二)「高風險系統」

高風險AI系統範圍廣泛,《歐盟人工智慧法草案》對此類系統訂定嚴密的風險控制措施,並要求須識別風險的所在,透過管控風險措施、進行測試以滿足各種要求。亦即並非一味禁止這類系統,而是採取高度監管方式處理。

常見的高風險AI系統像是:

關鍵基礎設施,例如道路交通與水電熱氣供應的系統,有可能將市民的生命與健康至於危險之中;

錄取學生、評估學習成果的系統(例如成績篩選系統);

就業、員工管理等系統(例如常見的CV篩選系統);

評估是否能享受公用與私人福利的系統(例如貸款篩選系統)

執法機構用於評估證據可靠性、犯罪發生可能性等的系統(例如評價證據是否可以使用、證據力與證明力等系統)

移民、庇護與邊境管理系統(例如確認旅遊文件是否真實之系統)

司法機關與民主程序所使用的系統(例如解釋法律與涵攝之系統)

所有「遠端生物特徵識別系統」(remote biometric identification systems)皆屬於高風險類別,因此受到嚴格的要求與限制。原則上,禁止在公共場所使用遠端生物特徵識別系統作為執法目的,例如「人臉辨識」(facial recognition)。[8]

若AI系統屬於「高風險」,在使用上有嚴格的義務與合規性要求,包括:「風險管理系統」(Risk management system)、「準確性、穩健性及網路安全」(Accuracy, robustness and cybersecurity)、「資料與資料治理」(Data and data governance)、「人類監督」(Human oversight)、「透明度並向使用者提供資訊」(Transparency and provision of information to users)、「記錄保留」(Record keeping)以及「技術文件」(Technical Documentation)。

此外,高風險AI系統必須是預先經過相關部門評估合格才能進入市場並投入使用,僅有在某些特定情況使得例外使用,例如用以協尋失蹤孩童、或是遭受恐怖分子攻擊而有立即性危險等。

(三)「有限的風險系統」

有限風險系統係指具有特定透明度(transparency)義務的AI系統,透過要求該系統履行「訊息透明」等義務,對其進行較為有限的規制,例如聊天機器人或「AI換臉」這類AI系統在與人類互動時,必須讓用戶意識到自己是在與「機器」而非自然人對話,以便能夠做出知情決策。

(四)「最小或無風險系統」

指不屬於上述種類的AI系統類別,例如AI電子遊戲或垃圾郵件過濾等系統,原則上可自由投入使用。目前在歐盟境內大部分所使用的AI系統屬於此類別。

參、趨勢研判

一、AI可能帶來的安全影響

這類「通用目的人工智慧」或具有生成式能力AI的特性為有極為龐大的規模、不透明性,以及可能超出原本開發者預期之能力,帶來了一系列問題與風險,除了可能對人的基本權利以及人身安全造成潛在威脅,ChatGPT這種大型語言模型(large language models, LLMs)本身即存在著道德與社會風險,例如可能會有歧視性問題甚至是可能煽動仇恨與暴力,並對個人與敏感資訊帶來風險。[9] 另外令人擔憂的是,AI更可能被操控與作為攻擊使用,例如可能被用來做自動化網路攻擊、通過社交工程欺騙使用者,或者操縱資料與資訊來傳播虛假資訊與假新聞。

雖然工程師等在開發時已經盡量減低這些風險的存在,然而新一代LLMs(像是GPT-4)對使用者之安全與基本權利仍然帶來不少挑戰。《歐盟人工智慧法草案》亦有對此做出不少監管要求,特別是透明度義務以及問責制的部分,例如要求供應商必須採取特定措施與事前評估等,盡可能保護使用者免受潛在危害。不過,這在實務上仍有其困難,或許須待該法正式通過與實施後才能評價其成效。

二、AI監管之立法方式仍有修正空間

由於AI系統訓練過程中須使用大量資料集進行訓練與有效運作,故涉及如何平衡隱私與資料保護的難題,像是隱私外洩以及未經授權取得或使用個資的風險。雖然《歐盟人工智慧法草案》強調了資料保護的重要性,但以「風險」來判定監管強度而非其「預期目的」可能會帶來新的漏洞,亦有批評者認為應像歐盟《一般資料保護規則》(General Data Protection Regulation, GDPR)採取「權利基礎」的立法方式。[10]

依照目前草案「技術中立」(technology neutral)立法原則,其不直接對生成式AI做規範,而是依據特定使用方式可能帶來的風險做判定,這是因為對「通用目的人工智慧」或是「基礎模型AI」的認定乃是「技術」,而非「使用」。亦即,《歐盟人工智慧法草案》依照AI應用之具體用途做規範,而並非依據基本的基礎模型。因此,亦有組織認為應將這類「通用目的人工智慧」放入該法之中,[11] 以利監管,亦有主張應將「通用目的人工智慧」另作一種風險類別。

[1] “DRAFT Compromise Amendments on The Draft Report, Proposal for A Regulation of The European Parliament and Of the Council on Harmonised Rules on Artificial Intelligence (Artificial Intelligence Act) and Amending Certain Union Legislative Acts,” European Parliament, May 16, 2023, https://www.europarl.europa.eu/resources/library/media/20230516RES90302/20230516RES90302.pdf.

[2]中國2023年4月11日提出了《生成式人工智能服務管理辦法》草案,但具體時程尚不明。

[3]“The EU’s AI Act: A Guide to Understanding the Ambitious Plans to Regulate Artificial Intelligence,” euronews, May 16, 2023, https://www.euronews.com/next/2023/05/15/the-eus-ai-act-a-guide-to-understanding-the-ambitious-plans-to-regulate-artificial-intelli.

[4]“Proposal For a Regulation of The European Parliament and of the Council on Harmonised Rules on Artificial Intelligence (Artificial Intelligence Act) And Amending Certain Union Legislative Acts,” European Commission, April 21, 2021, https://eur-lex.europa.eu/legal-content/EN/TXT/?uri=CELEX%3A52021PC0206.

[5]“General-Purpose Artificial Intelligence,” European Parliament, March 2023, https://www.europarl.europa.eu/RegData/etudes/ATAG/2023/745708/EPRS_ATA(2023)745708_EN.pdf.

[6]同前註。

[7] “Regulatory Framework Proposal on Artificial Intelligence,” European Commission, September 29, 2022, https://digital-strategy.ec.europa.eu/en/policies/regulatory-framework-ai.

[8] “EU Draft AI Act Updated with Public Facial Recognition Ban,” Cointelegraph, May 11, 2023, https://cointelegraph.com/news/eu-ai-act-updated-with-public-facial-recognition-ban. 關於「人臉辨識」議題,可參考 “Regulating Facial Recognition in The EU,” European Parliament, September 2021, https://reurl.cc/DA9xpQ.

[9]〈三星禁員工使用ChatGPT 避免商業機密外洩〉,《上報》,2023年5月2日,https://www.upmedia.mg/news_info.php?Type=3&SerialNo=171709。

[10] “The EU Should Regulate AI On the Basis of Rights, Not Risks,” accessnow, February 17, 2021, https://reurl.cc/94EWAv.

[11] “General Purpose AI and the AI Act,” Future of Life, May 2022, https://artificialintelligenceact.eu/wp-content/uploads/2022/05/General-Purpose-AI-and-the-AI-Act.pdf.